Step3-VL-10B:10B 参数视觉语言模型如何与大 20 倍的模型相媲美

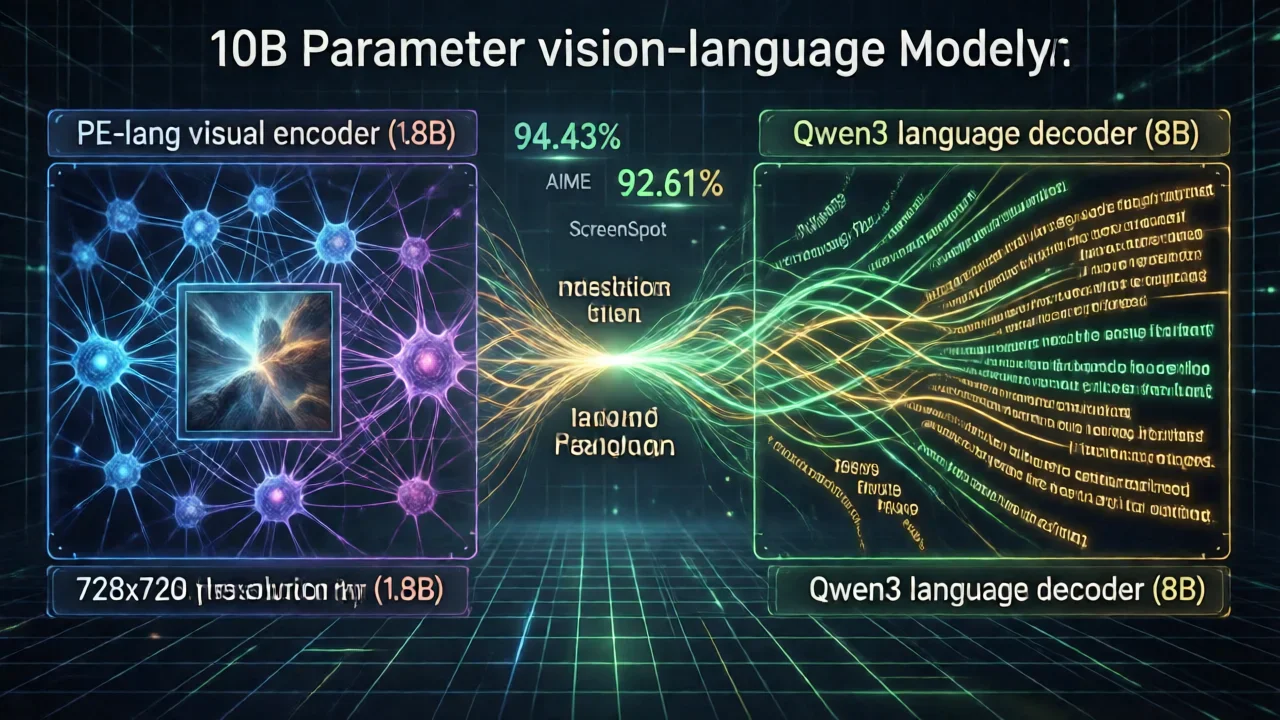

2026 年 1 月,Stepfun AI 发布了 Step3-VL-10B。这是一个 10 亿参数的视觉语言模型,做了一件不寻常的事——它的性能媲美大 10-20 倍的模型。秘诀是把 1.8B 的 PE-lang 视觉编码器和 8B 的 Qwen3 语言解码器结合在一起。如果你需要用视觉语言模型做 STEM 推理、文档理解或 GUI 交互,这个模型值得看看。

Step3-VL-10B 的革命性之处

Step3-VL-10B 有什么不同?Stepfun AI 没有简单地堆砌参数,而是设计了一个更聪明的架构。他们的目标是通过更好的训练和架构设计,从每个参数中获得更多性能。

PE-lang 的优势

Step3-VL-10B 的核心竞争力是 PE-lang(语言优化感知编码器)——一个 1.8B 参数的视觉编码器,专门为语言密集型任务设计。大多数视觉编码器关注视觉特征提取。PE-lang 不同,它提取的信息格式让语言模型能更有效地推理。

关键架构创新:

- 多裁剪分辨率策略:728×728 全局视图 + 多个 504×504 局部裁剪

- 16 倍空间下采样:通过两层步长为 2 的投影层实现高效的视觉令牌压缩

- 语言对齐的令牌化:视觉令牌优化以实现与语言模型的无缝集成

这种设计理念解释了为什么 Step3-VL-10B 在需要深层语义理解的任务上表现出色——视觉编码器被训练为以语言模型最能有效推理的格式提取信息。

统一的训练流程

Step3-VL-10B 的卓越性能源于精心设计的训练流程:

预训练阶段:

- 1.2 万亿令牌的多模态数据

- 单阶段、完全解冻的训练策略

- 全面覆盖视觉和文本领域

监督微调(SFT):

- 约 226 亿令牌

- 两阶段方法用于渐进式能力开发

- 专注于指令跟随和推理任务

强化学习(RL):

- 超过 1,400 次 RL 迭代,结合多种策略

- RLVR(视觉语言奖励强化学习)

- RLHF(人类反馈强化学习)

- PaCoRe(并行协调推理)训练

这种多阶段方法确保模型在保持视觉理解准确性的同时,开发出强大的推理能力。

性能基准:Step3-VL-10B vs. 更大的模型

Step3-VL-10B 效率最有说服力的证据是它与大得多的竞争对手的性能对比。

STEM 推理卓越性能

Step3-VL-10B 在数学和物理基准测试中表现出色:

| 基准测试 | Step3-VL-10B | 更大的模型 | 优势 |

|---|---|---|---|

| AIME 2025 | 94.43%(PaCoRe) | ~85-90% | +4-9% |

| HMMT 2025 | 92.14%(PaCoRe) | ~80-85% | +7-12% |

| MathVision | 75.95%(PaCoRe) | ~65-70% | +6-11% |

| OCRBench | 89.00% | ~80-85% | +4-9% |

考虑到 Step3-VL-10B 用 10-20 倍更少的参数实现这些成果,这些结果特别令人印象深刻。

通用视觉语言理解

除了 STEM 推理,Step3-VL-10B 在多个基准测试中保持竞争力:

| 基准测试 | Step3-VL-10B | 类别 |

|---|---|---|

| MMMU | 78.11% | 多模态推理 |

| MMBench(英文) | 92.05% | 通用视觉理解 |

| MathVista | 83.97% | 数学视觉推理 |

| ScreenSpot-V2 | 92.61% | GUI 理解 |

ScreenSpot-V2 的得分特别值得注意——92.61% 展示了 Step3-VL-10B 理解和交互用户界面的能力,使其对自动化和可访问性应用很有价值。

PaCoRe 的优势

Step3-VL-10B 的许多高分利用了 PaCoRe(并行协调推理),一种聚合 16 个并行推理过程的推理时技术。这种方法:

- 无需重新训练即可增强推理准确性

- 推理成本与推理过程数量成正比

- 提供可调的性能-效率权衡

- 对复杂推理任务特别有效

对于准确性至关重要的应用,PaCoRe 模式提供显著的性能提升。对于延迟敏感的应用,标准推理模式以较低的计算开销提供出色的性能。

技术规格和硬件要求

理解 Step3-VL-10B 的技术要求对部署规划至关重要。

模型架构详情

| 组件 | 规格 |

|---|---|

| 总参数量 | 100 亿 |

| 视觉编码器(PE-lang) | 18 亿参数 |

| 语言解码器(Qwen3) | 80 亿参数 |

| 模型权重大小 | 20 GB |

| 数据类型 | BF16(脑浮点 16) |

| 视觉分辨率 | 728×728 全局 + 504×504 局部裁剪 |

| 空间下采样 | 16 倍压缩 |

| 许可证 | Apache 2.0 |

硬件要求

推理最小配置:

- VRAM 需求:最少 24 GB

- 推荐 GPU:RTX 4090、A100、H100

- 模型权重:20 GB

- 运行时开销:约 4 GB

- 总内存:约 24 GB

生产推荐配置:

- VRAM:40-80 GB(用于批处理和 PaCoRe 模式)

- GPU:A100(80GB)或 H100(80GB)

- 存储:30 GB(模型 + 缓存)

软件要求:

- Python 3.10 或更高版本

- PyTorch ≥ 2.1.0

- Transformers 4.57.0

- CUDA 11.8 或更高版本(用于 GPU 推理)

推理格式

Step3-VL-10B 专门使用 BF16(脑浮点 16) 格式运行。这种精度级别:

- 为深层推理保持数值稳定性

- 相比 FP32 减少内存需求

- 为视觉语言任务提供充分的精度

- 被现代 GPU 广泛支持

不正式支持量化到 INT8 或 INT4,尽管社区可能会探索这个方向。

核心能力和使用场景

Step3-VL-10B 在多个领域表现出色,每个领域都利用其架构的不同方面。

1. STEM 问题求解

模型的卓越 STEM 推理性能使其理想用于:

- 数学辅导:求解和解释复杂的数学问题

- 物理模拟:理解和分析物理图表

- 化学可视化:解释分子结构和反应

- 工程分析:理解技术图表和规格

使用场景示例:学生上传手写数学问题。Step3-VL-10B 分析图像,识别数学符号,并提供分步解决方案。

2. 文档理解和 OCR

凭借 89% 的 OCRBench 性能,Step3-VL-10B 处理:

- 文档数字化:将扫描文档转换为结构化数据

- 表单处理:从表单和应用中提取信息

- 收据分析:理解和分类收据内容

- 发票处理:自动化发票数据提取

模型的多裁剪分辨率策略确保它既能捕捉细节(局部裁剪),也能捕捉整体文档结构(全局视图)。

3. GUI 和屏幕理解

92.61% 的 ScreenSpot-V2 得分展示了以下能力:

- UI 自动化:理解和与应用界面交互

- 可访问性:为视障用户描述屏幕内容

- 测试自动化:为自动化测试识别 UI 元素

- 移动应用分析:理解移动应用布局

4. 视觉问答

Step3-VL-10B 可以回答关于图像的复杂问题:

- 场景理解:描述图像中发生的事情

- 对象关系:理解对象之间的空间关系

- 上下文推理:推断未明确显示的信息

- 多步推理:回答需要多个推理步骤的问题

部署选项

Step3-VL-10B 支持多种部署方法,每种都针对不同的使用场景进行了优化。

选项 1:Hugging Face Transformers(开发)

对于开发和实验,使用标准 Transformers 库:

from transformers import AutoProcessor, AutoModelForCausalLM

model_path = "stepfun-ai/Step3-VL-10B"

processor = AutoProcessor.from_pretrained(model_path, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

model_path,

trust_remote_code=True,

device_map="auto",

torch_dtype="auto"

).eval()

# 准备输入

messages = [

{

"role": "user",

"content": [

{"type": "image", "url": "image_url_or_path"},

{"type": "text", "text": "这张图片里有什么?"}

]

}

]

# 生成响应

inputs = processor.apply_chat_template(

messages, add_generation_prompt=True, tokenize=True,

return_dict=True, return_tensors="pt"

).to(model.device)

generate_ids = model.generate(**inputs, max_new_tokens=1024)

response = processor.decode(generate_ids[0, inputs["input_ids"].shape[-1]:], skip_special_tokens=True)

print(response)

优势:

- 简单的设置和实验

- 直接访问模型内部

- 适合研究和原型设计

限制:

- 单请求处理

- 没有内置批处理优化

- 生产功能有限

选项 2:vLLM(生产 API)

对于需要 OpenAI 兼容 API 的生产部署:

vllm serve stepfun-ai/Step3-VL-10B \

-tp 1 \

--reasoning-parser deepseek_r1 \

--enable-auto-tool-choice \

--tool-call-parser hermes \

--trust-remote-code

优势:

- OpenAI 兼容 API

- 高效的批处理和调度

- 支持高级推理模式

- 生产就绪的性能

理想用于:

- REST API 服务

- 批处理

- 多用户应用

选项 3:SGLang(高性能推理)

为了获得最大性能和高级功能:

sglang serve \

--model-path stepfun-ai/Step3-VL-10B \

--trust-remote-code \

--port 2345 \

--reasoning-parser deepseek-r1 \

--tool-call-parser hermes

优势:

- 优化的推理性能

- 高级调度算法

- 支持复杂推理工作流

- 灵活的部署选项

理想用于:

- 高吞吐量应用

- 复杂推理任务

- 研究和实验

性能优化策略

为了在生产中最大化 Step3-VL-10B 的效率:

1. 批处理

同时处理多个请求以改进 GPU 利用率:

- 24GB VRAM 的批大小 4-8

- 80GB VRAM 的批大小 16-32

- 监控内存使用并相应调整

2. PaCoRe 模式调优

根据要求调整并行推理过程的数量:

- 标准模式:1 个推理过程(基线性能)

- PaCoRe-4:4 个推理过程(中等精度提升)

- PaCoRe-16:16 个推理过程(最大精度)

3. 输入优化

优化图像输入以提高效率:

- 将图像调整为适当分辨率(728×728 或更小)

- 使用 JPEG 压缩以提高存储效率

- 将相似大小的图像批处理在一起

4. 缓存策略

为重复查询实现缓存:

- 为相同输入缓存模型输出

- 使用 KV 缓存优化以进行顺序推理

- 为内存效率实现 LRU 缓存

与其他视觉语言模型的对比

为了理解 Step3-VL-10B 在市场中的位置:

vs. GPT-4V(闭源)

Step3-VL-10B 的优势:

- 开源且免费提供

- 可以自托管

- 推理成本更低

- STEM 推理性能相当

GPT-4V 的优势:

- 更广泛的通用知识

- 更精致的用户体验

- 持续的更新和改进

vs. Claude Vision(闭源)

Step3-VL-10B 的优势:

- 开源部署

- 专门的 STEM 推理

- 自托管部署的更低延迟

Claude Vision 的优势:

- 更广泛的推理能力

- 更好的细微理解

- 与 Claude 生态系统集成

vs. 开源替代品(LLaVA、Qwen-VL)

Step3-VL-10B 的优势:

- 卓越的 STEM 推理性能

- 更好的 OCR 和文档理解

- 更高效的参数使用

- 更强的 GUI 理解

LLaVA/Qwen-VL 的优势:

- 提供更小的模型变体

- 更广泛的社区支持

- 更多的部署示例

Step3-VL-10B 快速入门

第 1 步:环境设置

# 创建虚拟环境

python -m venv step3_env

source step3_env/bin/activate

# 安装依赖

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

pip install transformers>=4.57.0

pip install pillow requests

第 2 步:下载模型

# 使用 Hugging Face CLI

huggingface-cli download stepfun-ai/Step3-VL-10B --local-dir ./step3-vl-10b

第 3 步:运行推理

from transformers import AutoProcessor, AutoModelForCausalLM

from PIL import Image

import requests

# 加载模型

model_path = "./step3-vl-10b"

processor = AutoProcessor.from_pretrained(model_path, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

model_path,

trust_remote_code=True,

device_map="auto",

torch_dtype="auto"

).eval()

# 加载图像

image = Image.open("path/to/image.jpg")

# 准备输入

messages = [

{

"role": "user",

"content": [

{"type": "image", "image": image},

{"type": "text", "text": "详细分析这张图片。"}

]

}

]

# 生成响应

inputs = processor.apply_chat_template(

messages, add_generation_prompt=True, tokenize=True,

return_dict=True, return_tensors="pt"

).to(model.device)

with torch.no_grad():

generate_ids = model.generate(**inputs, max_new_tokens=2048)

response = processor.decode(generate_ids[0, inputs["input_ids"].shape[-1]:], skip_special_tokens=True)

print(response)

限制和注意事项

虽然 Step3-VL-10B 令人印象深刻,但理解其限制很重要:

1. 推理延迟

- 最少需要 24GB VRAM

- 推理时间:每张图像 5-15 秒(取决于复杂性)

- PaCoRe 模式按比例增加延迟

2. 知识截断

- 训练数据截断:2026 年初

- 可能缺少关于最近事件的信息

- 需要微调以获得特定领域的知识

3. 语言支持

- 主要针对英文和中文优化

- 支持其他语言但性能较低

- 多语言推理可能不够稳健

4. 专门任务

- 未针对实时视频处理优化

- 对音视频推理的支持有限

- 在没有微调的情况下可能在高度专业化的领域中遇到困难

未来发展和路线图

视觉语言模型的格局在不断演变。Step3-VL-10B 的潜在未来发展包括:

- 量化变体:INT8 和 INT4 版本用于边缘部署

- 更小的模型:3B 和 5B 参数变体用于资源受限的环境

- 多模态扩展:与音频和视频理解的集成

- 微调变体:用于专业应用的特定领域版本

- 效率改进:PE-lang 架构的进一步优化

总结

Step3-VL-10B 代表了高效视觉语言模型设计的重大成就。通过结合创新架构(PE-lang 编码器)、复杂的训练策略(带 RL 的多阶段流程)和精心的参数分配(1.8B + 8B 分割),Stepfun AI 创建了一个模型,在保持自托管部署实用性的同时提供卓越的性能。

无论你是在构建 STEM 辅导系统、文档处理管道还是 GUI 自动化工具,Step3-VL-10B 都提供了能力、效率和可访问性的引人注目的组合。该模型的开源 Apache 2.0 许可证确保你可以在研究和商业应用中自由部署它。

高效、强大的视觉语言模型时代已经到来。Step3-VL-10B 正在引领潮流。

资源: